人工智能是自动驾驶汽车的关键技术,可用于决策、传感、预测建模和其他任务。但这些人工智能系统在受到攻击时有多脆弱?

据外媒报道,布法罗大学(University at Buffalo)正在进行的研究探讨了这个问题,结果表明恶意行为者可能会导致这些系统失效。例如,通过在车辆上策略性地放置3D打印物体,可以掩盖车辆的检测,从而使车辆对人工智能雷达系统隐形。

图片来源:布法罗大学

研究人员表示,这项研究是在受控研究环境中进行的,并不意味着现有的自动驾驶汽车不安全。尽管如此,它可能对汽车、科技、保险和其他行业以及政府监管机构和政策制定者产生影响。

“尽管自动驾驶汽车在如今仍然是新事物,但它有望在不久的将来成为一种主要的交通方式,”纽约州立大学(SUNY)计算机科学与工程系杰出教授、这项研究的负责人Chunming Qiao表示。“因此,我们需要确保为这些车辆提供动力的技术系统,特别是人工智能模型,不受对抗行为的影响。这是我们布法罗大学正在努力研究的事情。”

毫米波检测有效,但易受攻击

过去三年来,研究人员Yi Zhu和Qiao团队的其他成员一直在布法罗大学北校区对一辆自动驾驶汽车进行测试。

Yi Zhu于5月从布法罗大学计算机科学与工程系获得博士学位,最近接受了韦恩州立大学(Wayne State University)的教职。

“在自动驾驶领域,毫米波雷达已被广泛用于物体检测,因为它在雨天、雾天和光线不足的条件下比许多摄像头更可靠、更准确。但雷达可以被黑客入侵,无论是通过数字方式还是通过人为方式。”Zhu表示。

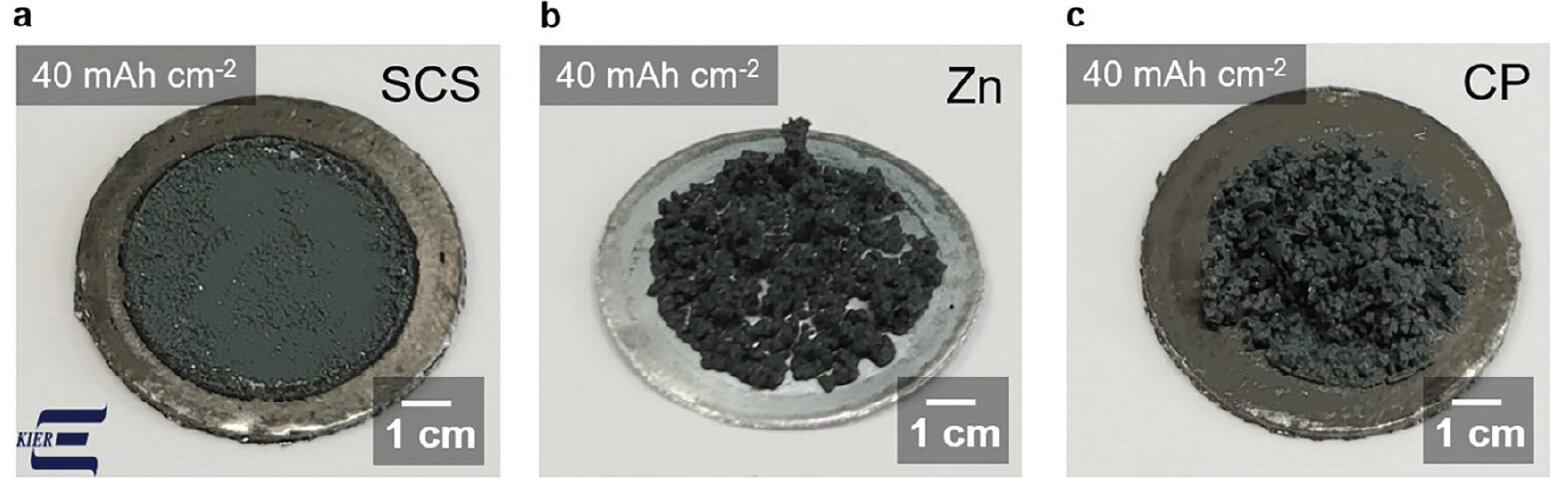

在一次测试中,研究人员使用3D打印机和金属箔制作出特定几何形状的物体,并将其称之为“瓦片掩模(tile masks)”。通过在车辆上放置两个瓦片掩模,研究人员发现它们可以误导AI模型进行雷达检测,从而使这辆车从雷达上消失。

攻击动机可能包括保险欺诈、AV竞争

Zhu指出,虽然AI可以处理大量信息,但如果给予它未经过训练的特殊指令,它也会感到困惑并提供不正确的信息。

“假设我们有一张猫的照片,AI可以正确识别这是一只猫。但如果我们稍微改变图像中的几个像素,那么AI可能会认为这是一张狗的图像,”Zhu表示。“这是AI的一个对抗性示例。近年来,研究人员已经为不同的AI模型发现或设计了许多对抗性示例。因此,我们问自己:是否有可能为自动驾驶汽车中的AI模型设计示例?”

图片来源:布法罗大学

研究人员指出,潜在的攻击者可以在驾驶员开始行程、临时停车或在红绿灯前停车之前偷偷将敌对物体粘在车辆上。他们甚至可以将物体放在行人佩戴的物品中,例如背包中,从而有效地消除对该行人的检测,Zhu说。

此类攻击的可能动机包括制造事故以进行保险欺诈、自动驾驶公司之间的竞争,或个人想要伤害另一辆车的驾驶员或乘客。

研究人员表示,值得注意的是,模拟攻击假设攻击者完全了解受害者车辆的雷达物体检测系统。虽然获取这些信息是可能的,但公众获得这些信息的可能性也不大。

安全性落后于其他技术

Zhu表示,大多数AV安全技术都侧重于车辆的内部,而很少有研究关注外部威胁。“安全性在某种程度上落后于其他技术。”虽然研究人员已经研究了阻止此类攻击的方法,但他们还没有找到明确的解决方案。

“我认为要建立万无一失的防御系统还有很长的路要走,”Zhu说。“未来,我们不仅要研究雷达的安全性,还要研究摄像头和运动规划等其他传感器的安全性。我们还希望开发一些防御解决方案来减轻这些攻击。”